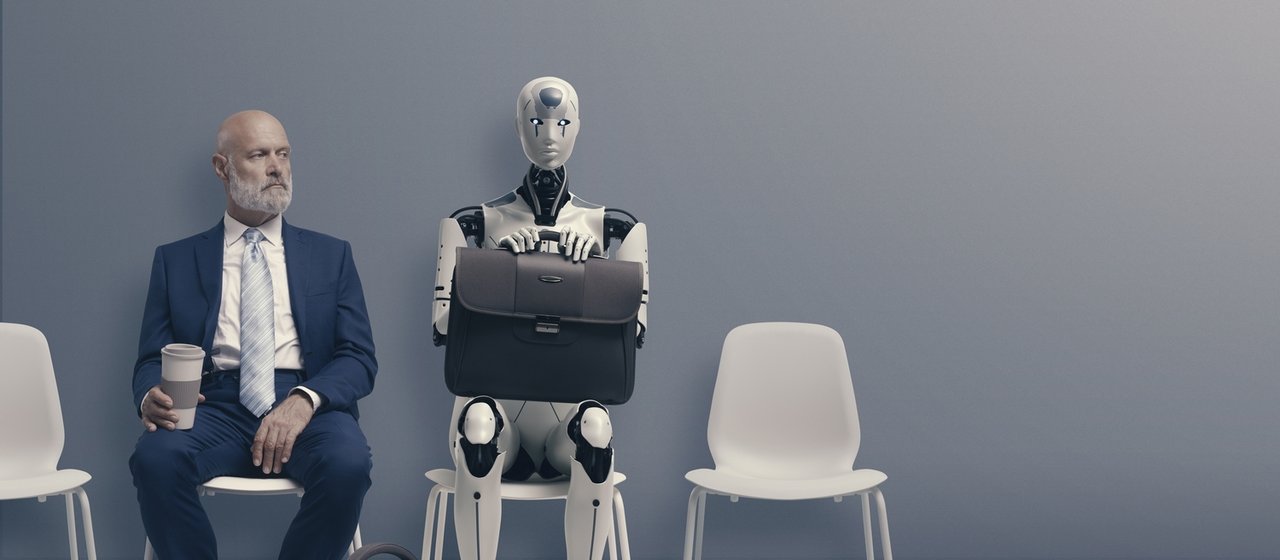

Stellenbewerber sind frustriert. Ihre Bewerbungen werden von künstlicher Intelligenz gelesen und gesichtet, was bedeutet, dass die Arbeitgeber selbst nicht sehen, wer ihrem Team beitreten möchte und wessen Fähigkeiten und Kompetenzen die noch unterentwickelte künstliche Intelligenz mit ihrem ‚Scannen‘ von Lebensläufen leicht übersehen kann, im Gegensatz zum nach wie vor menschlichen Bewerter. Ebenso stellt sich die Frage, wohin ihre Daten gehen, wo sie gespeichert werden und wer Zugang dazu hat, wenn ihre Daten durch künstliche Intelligenz-Tools laufen. Auf der anderen Seite gibt es auch Fälle, in denen KI-Bots Lebensläufe anpassen und sich auf viel mehr Stellen bewerben können als ein Mensch, was zu einer riesigen Anzahl von Bewerbungen für einen einzigen Job führt, die bei den Arbeitgebern eingehen. Vielleicht greifen sie deshalb auf die zu Beginn des Textes erwähnten Praktiken zurück, was einen Teufelskreis schafft. Und die künstliche Intelligenz, wie sie lautstark verkündet wird, soll helfen, viele Erfahrungen zu personalisieren und zu erleichtern – in diesem speziellen Fall, potenziellen Mitarbeitern zu helfen, schneller einen Job zu finden und Arbeitgebern zu helfen, die besten Kandidaten leichter auszuwählen. Die Frage stellt sich, in welche Richtung das Human Capital Management mit der Entwicklung der künstlichen Intelligenz geht und ob fortschrittliche Algorithmen HCM-Plattformen helfen oder schaden.

Das Problem der Voreingenommenheit

Wie in vielen anderen Branchen beschleunigen und automatisieren KI-Tools repetitive Aufgaben bei der Einstellung, was den Recruitern wertvolle Zeit für beispielsweise die Forschung auf dem Arbeitsmarkt spart. Programme zur Headhunting von Kandidaten, Automatisierung, Lebenslaufbewertung, Kandidatenrangierung und der Vergleich ihrer Fähigkeiten mit den Anforderungen der Stelle werden zunehmend eingesetzt, betont Valentina Haddad, Leiterin der Abteilung Rekrutierung und Auswahl bei der SELECTIO-Gruppe. Haddad weist jedoch auch darauf hin, dass es erhebliche Einschränkungen bei der Verwendung von KI-basierten HCM-Plattformen bei der Auswahl von Kandidaten gibt.

—

—

– Eine davon ist das Fehlen des menschlichen Faktors zur Bewertung von Soft Skills, Motivation und Persönlichkeit der Kandidaten sowie Voreingenommenheit. Wenn die Daten, auf denen KI trainiert wird, bereits voreingenommen sind – sei es aufgrund von Geschlecht, Rasse, Alter oder anderen Faktoren – können die Algorithmen diese Praktiken fortsetzen. Auch basieren solche Tools oft auf der Verwendung spezifischer Schlüsselwörter und können Kandidaten übersehen, die relevante Erfahrungen haben, aber in ihren Lebensläufen andere Begriffe verwenden – merkt Haddad an.

Dies kann jedoch in großen Arbeitsmärkten geschehen, merkt Haddad an, aber nicht in kleinen wie Kroatien oder den Märkten in der Region, in denen SELECTIO tätig ist.

—

Die derzeit geltenden EU-Vorschriften erlauben keine vollständig automatisierten Einstellungsentscheidungen, sondern erfordern weiterhin die Anwesenheit eines Menschen im Prozess.

—

– Angesichts der Tatsache, dass es derzeit einen Arbeitskräftemangel auf dem heimischen Arbeitsmarkt gibt, von geringqualifizierten bis hin zu hochqualifizierten Arbeitskräften, fehlen uns spezifische Zahlen, auf denen solche KI-Modelle angewendet werden könnten. Der Einsatz von KI-Modellen wäre bei Projekten zur Massenbeschäftigung von Vorteil, aber dies wird zunehmend schwierig, da solche Projekte umfangreicher und anspruchsvoller werden. Es sind erhebliche Rekrutierungsanstrengungen erforderlich, damit Investoren überhaupt geplante Unternehmen, Niederlassungen, Hotels oder Produktionsstätten in Kroatien eröffnen können. Um die Projekte, an denen wir arbeiten, erfolgreich abzuschließen, müssen wir uns in erster Linie auf das Wissen über die Besonderheiten aller Branchen verlassen und wissen, wie wir Kandidaten finden, deren Kompetenzen den Bedürfnissen der Kunden entsprechen. Basierend auf der Bewertung ihrer Fähigkeiten schlagen wir einen Kandidaten vor, der schnell ein Experte in einem bestimmten Bereich werden kann. Es gibt keine idealen Kandidaten mehr, die alle Anforderungen und Veränderungen auf dem Markt erfüllen. Daher ist Expertise, die auf jahrelanger Kandidatenbewertung basiert, erforderlich, um Kandidaten mit spezifischem und allgemeinem Wissen unter den vom Markt angebotenen zu identifizieren. Solches Wissen, zusammen mit sozialer und emotionaler Intelligenz und der Fähigkeit zu lernen und sich anzupassen, ist mit KI-Tools schwer zu erkennen. Deshalb bleiben Psychologen ein unersetzlicher Teil des Rekrutierungsprozesses – betont Haddad und fügt hinzu, dass die SELECTIO-Gruppe bestrebt ist, KI-Tools so zu nutzen, dass ihre Vorteile maximiert und Risiken minimiert werden.

Rutschige Bahn

Auf der Plattform zur Bewertung von Stellenbewerbern Selekcija.hr wird KI für das Parsen von Lebensläufen verwendet, d.h. die automatisierte Trennung von Teilen von Lebensläufen und die Eingabe in das Profil des Kandidaten, die Überwachung während der Testdurchführung (um beispielsweise auf mehrere Personen im Raum hinzuweisen), die Erstellung von Berichten nach dem Test und die Kommunikation mit Kandidaten im Kundenservice und interessierten Kunden über Chatbots. Sie werden bald die Sortierung von Kandidaten basierend auf Informationen aus Lebensläufen und Stellenbeschreibungen einführen. Für ihre Kunden erleichtert künstliche Intelligenz die täglichen Aufgaben bei der Rekrutierung und Auswahl von Kandidaten erheblich, betonen sie. Sie heben jedoch auch hervor, dass, obwohl KI Psychologen bei der Erstellung von Berichten unterstützen kann, sie sie nicht vollständig ersetzen kann.

– Obwohl künstliche Intelligenz Testergebnisse mit Informationen aus Lebensläufen und dem Text der Stellenanzeige kombinieren kann, muss jeder Bericht dennoch zusätzlich überprüft und korrigiert werden, da im von künstlicher Intelligenz generierten Text einige Unlogik, Tippfehler oder manchmal eine Fremdsprache auftreten können, ohne dass dies im Prompt irgendwo angegeben ist – erklären die Mitarbeiter von Selekcija.hr.

Die Anwendung von KI in der Rekrutierung und Auswahl ist ein rutschiger Boden, warnt Zvonimir Galić, ordentlicher Professor am Institut für Psychologie der Philosophischen Fakultät in Zagreb, da sie verschiedene ethische und sogar rechtliche Fragen aufwirft.

– Zum Beispiel haben wir Psychologen bisher bei der Beurteilung der wünschenswerten Eigenschaften von Kandidaten auf die Ergebnisse psychologischer Tests zurückgegriffen. Jetzt können wir mit demselben Ziel die Eigenschaften der Stimme, Gesichtsausdrücke oder Verhaltensindikatoren in sozialen Netzwerken analysieren. Für all diese Eigenschaften zeigen die neuesten Forschungen, dass sie mit Hilfe von KI Indikatoren für psychologische Merkmale sein können – erklärt Galić.

KI im HCM

Er äußert auch die Befürchtung, dass HCM-Plattformen, die auf KI basieren, noch nicht bereit für eine breite Anwendung sind.

—

—

– Nehmen wir zum Beispiel das Buch ‚The Algorithm‘, das in diesem Jahr in den USA veröffentlicht wurde und sich genau mit diesem Thema beschäftigt. Hilke Schellman von der NYU zählt alle Probleme auf, die entstanden sind, weil amerikanische Unternehmen, die traditionell innovationsfreudig sind, KI-Lösungen in der Auswahl von Stellenbewerbern implementiert haben. Die wichtigsten Probleme betreffen den Datenschutz, die Voreingenommenheit der Algorithmen und die Erklärbarkeit der Logik von KI-Algorithmen bei der Entscheidungsfindung über Einstellungen. Konkret, obwohl das Verhalten in sozialen Netzwerken öffentlich ist, dürfen Unternehmen die Analyse des ‚digitalen Fußabdrucks‘ für die Einstellung verwenden, da diese Daten nicht für diesen Zweck bestimmt sind? – fragt Galić zu Recht und fügt hinzu, dass Arbeitgeber manchmal einfach nicht erklären können, wie Entscheidungen, die auf komplexen KI-Algorithmen wie tiefen neuronalen Netzen basieren, getroffen wurden, was ein weiteres Problem bei der Verwendung von KI darstellt.

Ist es gerechtfertigt?

Die erste Voraussetzung für die Verwendung solcher Plattformen zur Rekrutierung und Auswahl ist ihre wissenschaftliche Fundierung, merkt Galić an. Obwohl die Wissenschaft oft hinter der Praxis zurückbleibt, überholen technologische Lösungen in der Anwendung von KI in der Rekrutierung und Auswahl sogar zu schnell die Praxis, ohne dass sie einen guten Test bestanden haben, ob sie überhaupt tragfähig sind, erklärt Galić, der auch Co-Leiter des universitären Spezialstudiums Human Capital Management an der Universität Zagreb ist. Aus diesem Grund versuchen er und seine Kollegen zu bestimmen, wie gerechtfertigt die Verwendung von KI in der Auswahl ist und mit welchen ethischen Fragen sie verbunden ist. Gerade in diesen Tagen wurde ihre Forschung darüber, ob sich mit KI-Verfahren ‚Lügner‘ in Bewerbungen identifizieren lassen, die viele Arbeitgeber beschäftigt, zur Veröffentlichung im International Journal of Selection and Assessment angenommen.

—

Obwohl die Wissenschaft oft hinter der Praxis zurückbleibt, überholen technologische Lösungen in der Anwendung von KI in der Rekrutierung und Auswahl sogar zu schnell die Praxis, ohne dass sie einen guten Test bestanden haben, ob sie überhaupt tragfähig sind.

—

Haddad hingegen merkt an, dass es Strategien gibt, um das Risiko von Voreingenommenheit zu verringern und die Zuverlässigkeit von HCM-Plattformen zu erhöhen. Dazu gehört beispielsweise die Verwendung vielfältiger Datenquellen zur Schulung von KI-Algorithmen, um repräsentative Ergebnisse zu gewährleisten, sowie die Bewertung und Überprüfung dieser KI-Tools, um sicherzustellen, dass sie bestimmte demografische Gruppen nicht bevorzugen.

– Es wird jedoch noch viel Zeit vergehen, bevor wir sicher sein können, dass KI-Tools vollständig unvoreingenommen sind, daher ist es wichtig, sich bei der Entscheidungsfindung auf den menschlichen Faktor zu verlassen – betont Haddad, die der Meinung ist, dass Empathie, Intuition und die Fähigkeit, subtile persönliche Merkmale zu erkennen, Qualitäten sind, die die Technologie noch nicht replizieren kann.

– Menschliche Interaktion in entscheidenden Phasen, wie Interviews, Verhandlungen und Karriereberatung, wird weiterhin notwendig sein, um Fairness und qualitativ hochwertige Entscheidungen zu gewährleisten. Es ist schwierig, ein Programm mit den höheren und komplexeren Konzepten zu schulen, die so typisch für Menschen sind, wie Zynismus und Sarkasmus. Obwohl bekannt ist, dass in die Bewertungen, die wir durchführen, Lügen-Skalen und Skalen für sozial wünschenswertes Antworten einfließen, bleibt KI nur ein nützliches Werkzeug, und die Rolle von Recruitern und Psychologen ist unersetzlich – schließt Haddad.

Strenge Regeln

Von Selekcija.hr wird die Verwendung von KI im Kundenservice, beim Parsen von Lebensläufen und bei der Überwachung der Testdurchführung vorgeschlagen, aber auch die Überwachung durch HR-Experten bei der KI-Empfehlung eines Teils der Kandidaten. Denn, wie sie betonen, ist jeder Kandidat wichtig, auch wenn er nicht für die gesuchte Position geeignet ist.

– Aus Erfahrung wissen wir, dass er für eine andere Position bei einem Arbeitgeber gut sein kann, auch wenn er derzeit nicht alle gekennzeichneten Kriterien erfüllt, die KI derzeit beachtet. Besonders weil keiner unserer Kunden in den Ländern der Region mehrere tausend Bewerber für nur eine Position hat, wie es in London der Fall ist, ist ein solches Risiko im Verhältnis zum Zeitverlust akzeptabel – erklären die Mitarbeiter von Selekcija.hr.

Die derzeit geltenden EU-Vorschriften erlauben keine vollständig automatisierten Einstellungsentscheidungen, sondern erfordern weiterhin die Anwesenheit eines Menschen im Prozess, betont Galić, wobei er auf die GDPR-Bestimmung verweist, von der nur wenige Kandidaten wissen.

– Darüber hinaus ist die EU sehr streng in Bezug auf die wissenschaftliche Fundierung von Verfahren und verlangt von Arbeitgebern, dass sie den Kandidaten erklären, wie die verwendeten Algorithmen funktionieren. In der Rekrutierung und Auswahl bleibt die Zukunft eine Kombination aus Mensch und KI, da Forschungen zeigen, dass Menschen im Prinzip nicht gerne ausschließlich auf KI für diese Zwecke angewiesen sind und dies als invasiv empfinden – merkt Galić an und schließt, dass KI-Verfahren an sich nicht unbedingt unethisch sind, sie jedoch auf eine ethisch fragwürdige Weise angewendet werden können.